Hugging Face: o que é, como funciona e como usar

Se você está começando na área de Machine Learning ou Inteligência Artificial e pesquisou por 'o que é Hugging Face' ou 'como usar o Hugging Face', este artigo é para você!

Esse é o nome de uma plataforma que tem desempenhado um papel fundamental na democratização das tecnologias de IA e que tem se popularizado cada vez mais conforme a área cresce, tanto em conhecimento quanto em número de pessoas interessadas.

Neste artigo, você vai entender o que é Hugging Face, como funciona a plataforma, verá um passo a passo de como usar o Hugging Face na prática, inclusive com exemplos em Python (hugging face python) e como aproveitar seus principais recursos para projetos de IA.

O que é Hugging Face? Entenda a plataforma de IA

Hugging Face é uma plataforma colaborativa criada em 2016 que tem como objetivo democratizar o acesso ao aprendizado de máquina e à inteligência artificial. Se você se pergunta o que é Hugging Face, pense em um grande repositório open source de modelos de IA, datasets e ferramentas prontas para usar.

A plataforma funciona de maneira semelhante ao Github: é possível compartilhar projetos próprios, pesquisar, se inspirar ou clonar projetos de outras pessoas.

Em abril de 2026, o Hugging Face possui mais de 2 milhões de modelos disponíveis, capazes de lidar com processamento de texto, áudio e imagem.

Modelos de linguagem de grande porte (LLMs) como o GPT ou Gemini, por exemplo, exigem pagamento pela API para serem utilizados em código e não fornecem informações significativas sobre a arquitetura do treinamento do modelo ou sobre os dados utilizados.

Isso pode criar dificuldades para a utilização desses modelos e limitar a capacidade de outros desenvolvedores de ML de se inspirarem na tecnologia.

Por outro lado, a grande maioria dos modelos presentes no Hugging Face podem ser replicados de forma gratuita e são de código aberto.

Inclusive, algumas das empresas responsáveis por modelos proprietários também colaboram disponibilizando modelos Open Source no Hugging Face e investem na plataforma. O desenvolvimento da IA atualmente é predominantemente colaborativo, e o Hugging Face tem papel central nesse processo.

Tudo isso só é possível graças a uma comunidade altamente engajada.

Além do conhecimento compartilhado, outra vantagem significativa é a reutilização de treinamentos já executados. Treinar LLMs demanda muito tempo (de semanas a meses) e uma quantidade enorme de energia e recursos naturais.

A emissão de gases de efeito estufa gerada pelo treinamento de IAs deve ser considerada. A reutilização de modelos pré-treinados ajuda a mitigar o impacto ambiental dessa tecnologia.

Como usar o Hugging Face: navegando pelo hub da plataforma

Hub é o nome que se dá ao ambiente onde os diferentes produtos hospedados no Hugging Face estão reunidos.

Se você quer aprender como usar o Hugging Face na prática, veja agora como navegar pelas principais áreas da plataforma. Ao acessar a plataforma, encontramos diversas opções. Para quem está começando, pode parecer muita informação, mas aos poucos cada área faz sentido. Vamos explorar as principais abas e entender o que compõe o Hugging Face.

Para acessar todos os recursos do Hugging Face e conseguir usar modelos em código (por exemplo, usando Hugging Face com Python), é recomendado criar uma conta gratuita na plataforma.

A conta não é obrigatória para apenas navegar, mas ela é fundamental para quem quer aprender como usar o Hugging Face de forma programática, por exemplo, ao baixar modelos por código.

Os modelos são livres para uso, mas, em diversos deles, é preciso concordar com termos de uso ou compartilhar seu e-mail e nome de usuário, por exemplo, para ter o acesso permitido. Ao importar o modelo em um ambiente de desenvolvimento, é necessário se identificar, e é aí que entram os tokens de acesso.

Com o token de acesso, também é possível executar comandos git em seus repositórios hospedados no Hugging Face diretamente do ambiente de desenvolvimento.

A conta gratuita oferece acesso a muitos recursos, mas há também opções de planos pagos, com funcionalidades adicionais, incluindo uma versão enterprise com suporte prioritário.

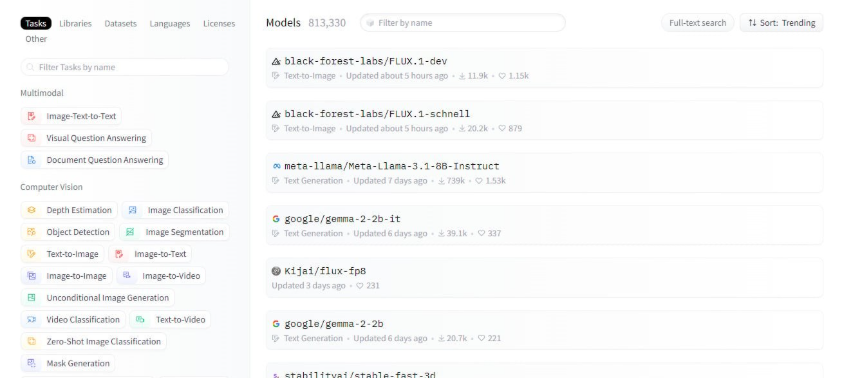

Modelos no Hugging Face: como encontrar e usar

Nessa aba podemos explorar os modelos públicos. Na lateral esquerda, há diversas opções de filtros que podem ser aplicados na busca pelo modelo ideal, de acordo com a necessidade específica.

É possível filtrar por tarefa desempenhada, língua, bibliotecas e dataset utilizados, entre outros critérios.

Entre as tarefas desempenhadas temos Processamento de Linguagem Natural, reconhecimento de voz, visão computacional, entre outros.

Mas… e como é o modelo?

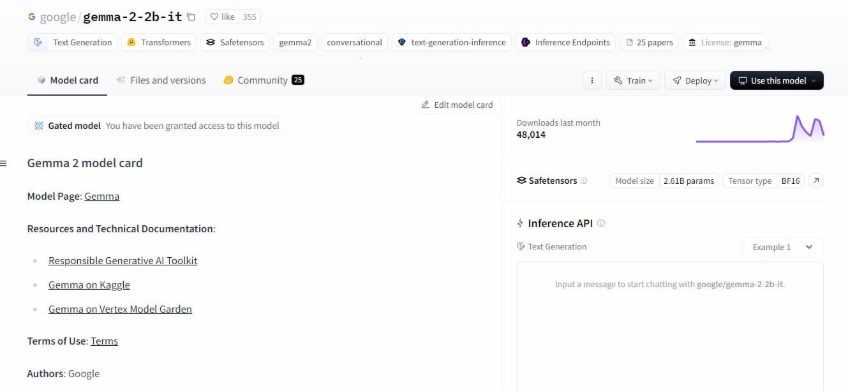

Vamos dar uma espiada no Gemma 2, um modelo lançado pelo Google e criado com a mesma base tecnológica do Gemini.

Na página do modelo, temos acesso a:

- Descrição do modelo, explicando o objetivo do modelo, informações sobre a pesquisa, documentação, entre outros.

- Arquivos e versões no repositório Github.

- Comentários da comunidade com dúvidas ou reportando problemas, por exemplo.

- API de inferência: uma interface para interagir com o modelo.

Além disso, é pela página do modelo que é possível fazer o download. No botão “Use this model”, estão disponíveis as linhas de código de acordo com a biblioteca integrada no projeto.

Dica: o nome dos modelos costuma ter valores como 124M, 2B, 70B, indicando a quantidade de parâmetros utilizados no treinamento.

A letra A letra M indica milhões e B bilhões de parâmetros. Modelos menores são mais leves e rápidos, enquanto modelos maiores costumam ter melhor desempenho em tarefas complexas.

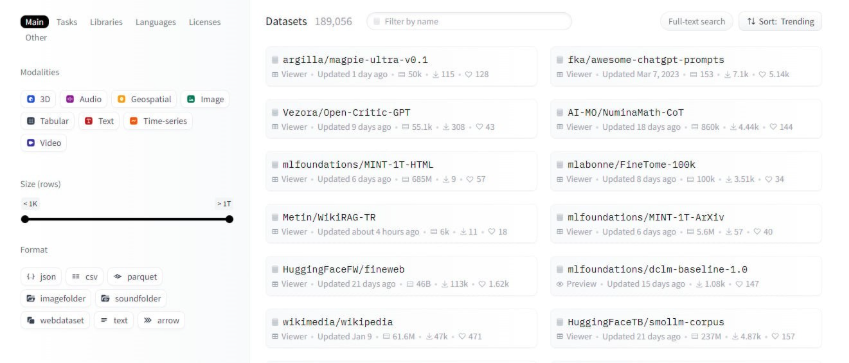

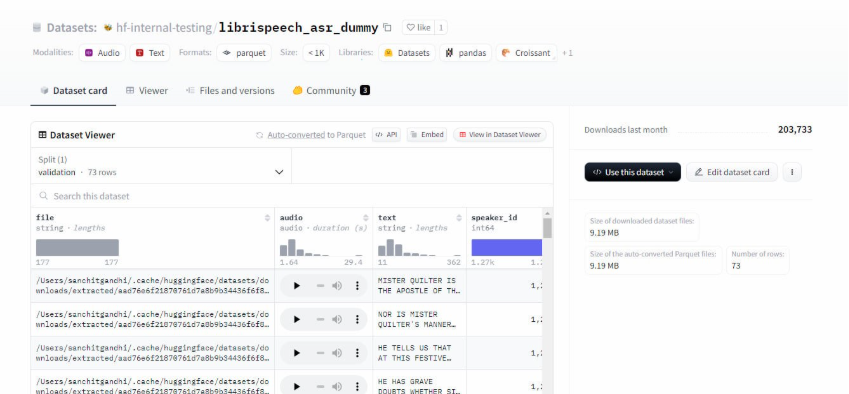

Datasets no Hugging Face: o que são e como usar

São os conjuntos de dados já ideais para a utilização em projetos de ML. Assim como na aba de modelos, há diversas opções de filtros que podem ser aplicados.

Esses conjuntos de dados podem ser utilizados, inclusive, para aplicar o fine-tuning (processo de ajustar um modelo pré-treinado com dados próprios para adaptá-lo a uma tarefa ou contexto específico) - isto é, treiná-lo de forma personalizada para que os resultados obtidos posteriormente fiquem mais próximos do que é o desejado.

Ao clicar em um dataset, podemos pré-visualizar a base de dados, seu repositório git, comentários da comunidade, bem como obter o código para importar o dataset para um projeto.

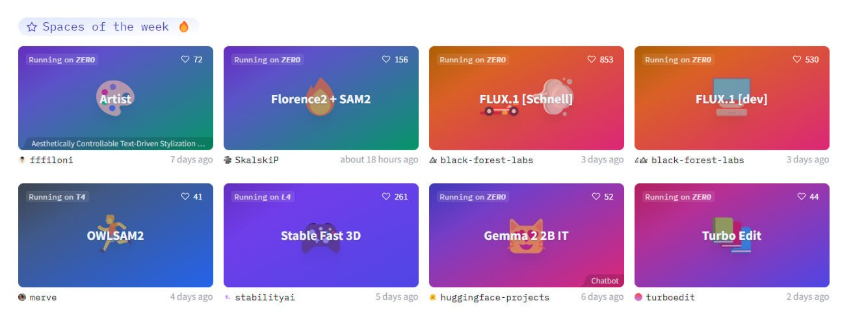

Spaces do Hugging Face: experimentando modelos e apps

Nessa seção, estão disponíveis projetos de Machine Learning criados por pessoas da comunidade usando diferentes modelos.

Esses trabalhos são chamados de apps quando estão hospedados, e muitos apps conterão informações interessantes sobre o modelo utilizado, link para os arquivos no Github e, algumas vezes, até referências acadêmicas da pesquisa.

Executar apps é uma forma interessante de ver os modelos em ação!

Criar um app no Hugging Face é simples: é possível escolher o SDK (kit de desenvolvimento de software) de Gradio ou Streamlit, ou ainda criar um espaço estático com HTML e CSS.

Então, basta adicionar o código. O app pode ser compartilhado por meio da URL e até ser fixado em uma página web! É uma ótima estratégia para enriquecer o portfólio.

Os espaços são gratuitos até 16GB de memória, 2 CPUs e 50GB de espaço em disco. Os espaços gratuitos incluem ZeroGPU com acesso dinâmico a GPUs NVIDIA. O plano PRO ($9/mês em 2026) oferece quota de ZeroGPU 8x maior com até 25 minutos de H200 compute diariamente, 1TB de armazenamento privado e 10TB público.

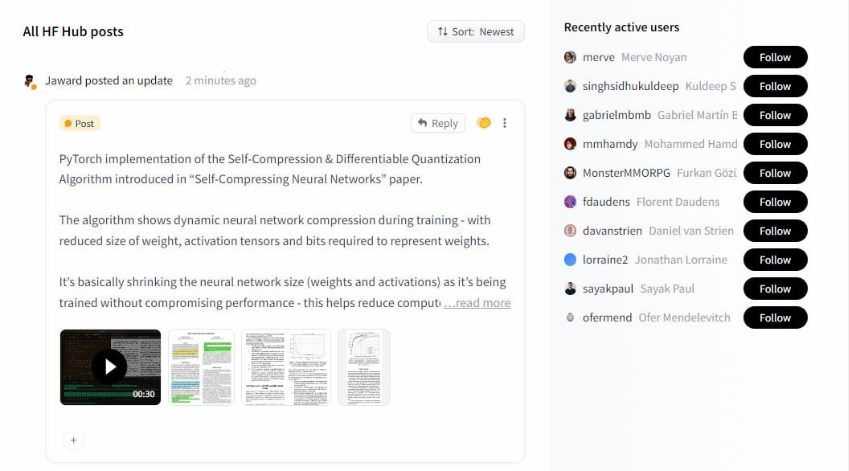

Posts e Comunidade no Hugging Face

Essa área é a parte social do Hugging Face, onde as pessoas usuárias postam suas explorações, reflexões, dúvidas e descobertas sobre a área de ML e IA.

É possível interagir com os posts e seguir as pessoas, assim como em uma rede social.

Documentação do Hugging Face: aprendendo mais

Nessa aba, está o acesso a uma extensa e detalhada documentação sobre cada um dos componentes do Hugging Face.

A documentação é a melhor amiga de quem desenvolve, e o Hugging Face valoriza isso. É uma documentação clara e de alto nível, que auxilia o uso da plataforma mesmo para pessoas que não tem ampla experiência na área.

O hub conta com uma interface bastante amigável para navegação. Mas pode surgir o desejo de interagir com o hub sem sair do ambiente de desenvolvimento, e isso é possível através da biblioteca huggingface-hub para Python ou huggingface.js para Javascript.

O que é o Transformers do Hugging Face e para que serve?

Transformers é uma biblioteca desenvolvida pelo Hugging Face que permite a utilização de vários dos modelos pré-treinados disponíveis no hub.

A biblioteca implementa a arquitetura Transformers, que utiliza paralelização e mecanismos de atenção para capturar relacionamentos complexos em textos. A biblioteca também oferece suporte a modelos que não são baseados nessa arquitetura.

Com Transformers, temos integração com Pytorch e Tensorflow, frameworks amplamente utilizados no treinamento de modelos de aprendizado profundo.

Uma das funções mais úteis da Transformers é a `pipeline`, um objeto que encapsula todas as outras pipelines presentes no modelo. São algumas delas:

- Classificação de texto

- Reconhecimento de fala

- Geração de texto

- Segmentação de imagens

- Imagem para texto

- Texto para imagem

Para conferir todos os pipelines disponíveis, confira na documentação.

Com poucas linhas de código, já é possível executar essas tarefas e escolher entre uma variedade de modelos disponíveis no Hub.

No contexto da biblioteca, pipeline pode ser entendido como um fluxo de trabalho composto por etapas encadeadas para realizar uma tarefa. Essas etapas são:

- Pré-processamento: o input é convertido em tokens, que são pedacinhos de palavras que mantêm seu significado original.

- Uso do modelo: o modelo entra em ação. Os tokens são convertidos em embeddings, uma representação matemática dos tokens, que permite que a tarefa seja executada de acordo com a arquitetura e treinamento do modelo.

- Pós-processamento: acontece a decodificação e a saída do modelo é transformada em uma resposta compreensível.

Vamos experimentar?

Como usar o Hugging Face na prática: aplicando um modelo com Python

Vamos testar a importação de um modelo do Hugging Face com a biblioteca Transformers, utilizando Python!

Recomendo testar os modelos em notebooks do Google Colab, afinal, muitos dos modelos exigem bastante poder de computação e podem ser custosos dependendo das configurações e recursos de hardware que você tem disponíveis.

Ainda assim, a memória disponibilizada pelo Colab também pode não ser suficiente para modelos muito grandes.

Caso prefira rodar o código localmente, é super importante criar um ambiente virtual. Você pode seguir os passos do artigo Ambientes virtuais em Python.

Com o ambiente criado e ativado, instale o Transformers:

pip install transformers É recomendado, também, fazer a instalação do back-end que será utilizado no projeto, seja o PyTorch, o Tensorflow ou ambos.

Porém, o Transformers não exige que esses pacotes estejam instalados durante a execução de alguns modelos no pipeline - nesse caso, o framework utilizado na base do modelo escolhido será instalado automaticamente no momento da execução.

Como usar o Hugging Face Python: passo a passo

Inicie um novo notebook no Colab. Para utilizar essa ferramenta, basta estar logado em uma conta Google.

Então, na primeira célula, insira o seguinte código. Execute.

from transformers import pipeline O objeto pipeline, como vimos, oferece diversas opções de fluxo de trabalho. Basta importá-lo para começarmos a experimentar o poder dos Transformers.

Veja como é simples usar o Hugging Face Python para análise de sentimentos com poucas linhas de código.

Análise de sentimento

Uma das tarefas performadas é a análise de sentimentos. Observe o código:

classificador = pipeline("sentiment-analysis")

classificador(['O Hugging Face é incrível!', 'Tenho muito a aprender, preciso me organizar'])Criamos um objeto “classificador” contendo o fluxo de trabalho sentiment-analysis. Então, passamos uma lista de frases para esse objeto classificador.

O retorno é uma lista de dicionários. Cada dicionário é referente à frase correspondente enviada no classificador, e contém o label para o sentimento (positivo ou negativo) e um score, que é o nível de confiança da label. Quanto mais próximo de 1, mais chance de a classificação ser verdadeira.

[{'label': 'POSITIVE', 'score': 0.9751573801040649},

{'label': 'NEGATIVE', 'score': 0.9701449871063232}]Gerador de texto

Outro exemplo de como usar o Hugging Face Python é a geração de texto automática com modelos pré-treinados.

Com o pipeline text-generation, é possível gerar textos automaticamente.

Se copiarmos a mesma estrutura utilizada no exemplo anterior, temos algo assim:

gerador_de_texto = pipeline('text-generation')

gerador_de_texto('Tenho pimentões e berinjelas na geladeira. Vou')Ao executar essa célula, esperava que o resultado fosse o nome de alguma receita mediterrânea ou turca, mas o retorno foi o seguinte:

[{'generated_text': 'Tenho pimentões e berinjelas na geladeira. Vou darás na hacia tambiarjema!\n\nHacerla toluas ajús haberinjedos'}] Neste exemplo, percebemos que o modelo padrão de geração de texto não possui suporte ao português.

E se o input for em inglês?

gerador_de_texto = pipeline('text-generation')

gerador_de_texto('I might bake a chocolate')Temos um retorno que é coerente. O texto gerado é um diálogo que permanece na mesma língua e cria um contexto razoável.

[{'generated_text': 'I might bake a chocolate cake!"\n\nHanna: "My goodness, honey. That\'ll be delicious! I want to make something special for my family..."\n\nBetsy: "Well what do you think?"\n\nHanna:'}] Felizmente, é possível filtrar os modelos no Hub por idioma. Por exemplo, o Aira-2-portuguese-124M, criado por Nicholas Kluge Corrêa, oferece suporte ao português.

gerador_de_texto = pipeline('text-generation', model="nicholasKluge/Aira-2-portuguese-124M")

gerador_de_texto('Tenho pimentões e berinjelas na geladeira. Vou')A resposta foi:

[{'generated_text': 'Tenho pimentões e berinjelas na geladeira. Vou me ajudar a encontrar um bom restaurante perto de mim.Claro! Ficarei feliz em ajudá-lo a encontrar um bom restaurante perto de você. Para melhor atendê-los, precisarei saber sua localização atual ou o nome da cidade onde você está localizado. Você poderia me fornecer essa informação?'}] No exemplo acima, o modelo atuou como uma função de autocompletar frases, sugerindo que foi treinado para operar como um assistente pessoal.

É importante ter em mente que cada modelo terá suas particularidades e pode ter sido desenvolvido para objetivos específicos.

Atenção aos limites de uso: O tier gratuito do Hugging Face possui limites de requisições. Segundo a documentação oficial, existem diferentes buckets de rate limits aplicados em janelas de 5 minutos. Para uso em produção, considere os planos PRO ($9/mês) ou Enterprise, que oferecem limites significativamente maiores e suporte prioritário.

Vale a pena consultar a página de cada modelo para entender sua finalidade e métodos de uso, identificando qual se adapta melhor ao seu projeto.

Se você está aprendendo como usar Hugging Face com Python de forma completa, também precisará de um token de acesso para utilizar alguns modelos restritos

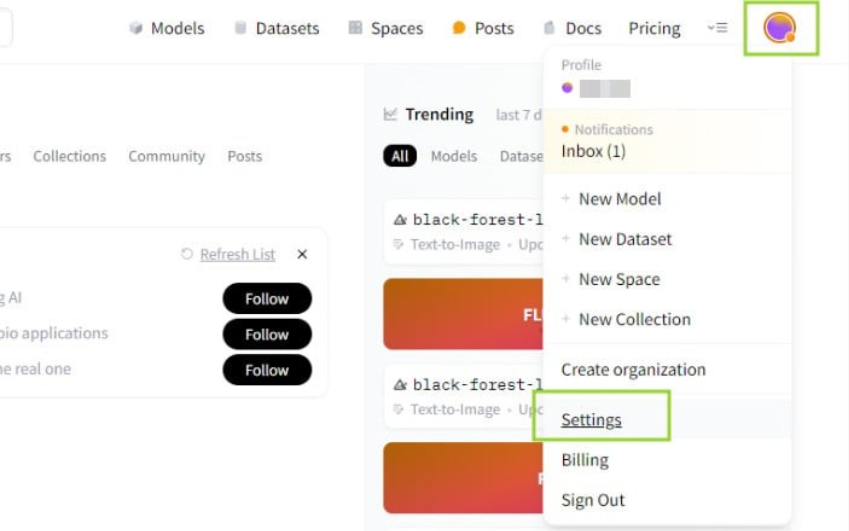

Criando um token

Quando o modelo escolhido é trancado (ou seja, possui acesso restrito no Hugging Face, exigindo autenticação), é preciso gerar um token de acesso e fazer a autenticação no ambiente de desenvolvimento.

Após o login no Hugging Face, clique no ícone do perfil (canto superior direito) e acesse Settings.

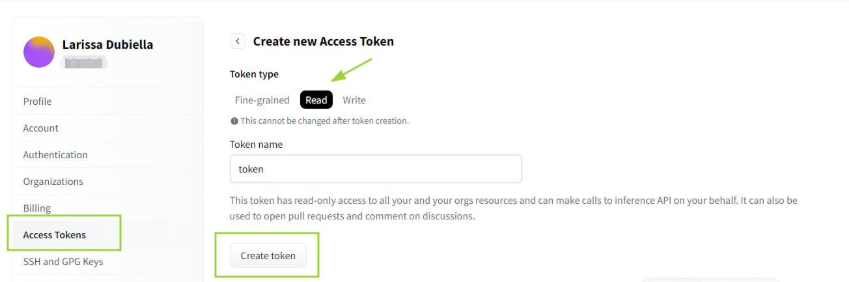

Então, na página de perfil, clique em Access Tokens no menu esquerdo. O tipo read é o ideal para o nível mais básico de uso, quando não serão feitas alterações no modelo em si.

Dê um nome ao token e crie. Copie o código e guarde em um lugar seguro - esse é o único momento em que esse código poderá ser copiado.

Então, no seu ambiente de desenvolvimento, execute:

from huggingface_hub import login

login()Preencha o campo com seu token. Pronto, o ambiente estará autenticado e os modelos que forem liberados para sua conta estarão disponíveis para uso.

Como aprender sobre Hugging Face e se aprofundar em IA e Python

A própria plataforma oferece cursos gratuitos de alta qualidade, vale a pena conferir!

Os cursos focam em diferentes tópicos da área de ML e IA e, apesar de serem bastante interessantes, podem ser desafiadores para quem está começando na área. Além disso, os vídeos são todos em inglês.

Aqui na Alura, temos uma formação inteirinha dedicada ao Hugging Face, além de formações que ensinam os conceitos de Machine Learning e a trabalhar com os frameworks citados ao longo do artigo.

- Hugging Face

- Machine Learning

- Machine Learning avançado

- Deep Learning com Tensorflow Keras

- Deep Learning com Pytorch

É altamente recomendado ter um conhecimento prévio de programação para trabalhar com o Hugging Face e com a biblioteca Transformers.

Se você está começando agora, dê seus primeiros passos com a formação Python para Data Science.

Neste artigo, você conheceu o que é o Hugging Face e experimentou um pouco da biblioteca Transformers. Continue explorando e evoluindo em IA com a gente!

Forte abraço e até breve.